一、方法简介

机器学习即服务(Machine Learning as a Service, MLaaS)作为云计算领域的重要创新模式,近年来呈现出显著的增长态势。该服务模式通过提供受限的API访问接口,使得终端用户能够以按需付费的方式便捷地获取先进的机器学习能力,而无需承担模型开发与维护的复杂技术成本。然而,这种服务模式的封闭性特征也带来了显著的技术挑战,MLaaS系统通常以黑盒形式呈现,用户无法获取模型的架构细节、训练方法以及训练数据分布等关键信息。这种信息不对称性不仅**了用户对模型决策过程的理解和信任,更在安全性和可解释性方面引入了潜在风险。在此背景下,模型窃取攻击,特别是无数据条件下的模型窃取方法,逐渐成为机器学习安全领域的重要研究方向。

图1: MGCT的完整训练概述

图1展示了本文提出的基于多生成器协同训练的模型窃取框架。MGCT采用双阶段迭代优化架构:(1)多生成器协同训练阶段,创新性地构建并行生成器组,通过分布式特征学习机制捕捉目标数据分布的互补子空间;(2)克隆模型训练阶段,在传统双克隆模型架构基础上,引入混合采样策略和经验回放优化器。在**阶段,各生成器通过对抗训练生成具有差异化特征表征的合成样本,其中生成器组间采用动态权重分配策略,有效缓解单生成器架构的梯度冲突问题。在第二阶段,设计基于信息熵的样本筛选机制,优先选择低置信度阈值样本进行训练,同时通过经验回放技术实现查询样本的跨批次复用。这两个阶段通过交替优化策略实现协同进化。经过迭代优化,**终获得的克隆模型与目标模型保持高度功能一致性。

二、实验评估

我们在相关数据集上进行了系统性实验,与当前主流无数据模型窃取方法(DFME、DFMS、DisGUIDE、DualCOS)进行了对比分析。这些结果表明,MGCT的多生成器架构可以在不同复杂性的数据集上提供稳定的性能。

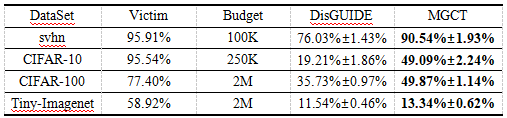

表1: **终克隆模型的分类性能比较(置信度95%)。Victim Model代表受害者模型架构。克隆模型默认使用ResNet-18。

如表1所示,MGCT框架在CIFAR系列数据集上取得了具有竞争力的性能。

表2: 有限预算设置下克隆模型的分类性能比较(置信度95%)。受害者模型和克隆模型均为ResNet-18。

表2的实验结果验证了混合采样策略在低预算条件下的有效性。MGCT在所有测试数据集上均展现出显著的性能优势。特别是在SVHN数据集上,仅使用100K查询预算即达到90.54%的克隆精度,较DisGUIDE提升了14.51%。在CIFAR-10数据集上,MGCT以49.09%的精度显著超越DisGUIDE(19.21%)。即使在CIFAR-100和Tiny-Imagenet等复杂数据集上,MGCT仍展现出一定的性能优势。

三、论文信息

相关论文已被Cybersecurity接受,作者是河南科技大学的高云龙、张志勇(通讯作者),梁晗和宋斌。

供稿:高云龙